Recientemente, se ha hablado cada vez más de que los agentes de IA reciben una orden y realmente llevan a cabo la tarea, incluidos los toques y deslizamientos necesarios en su teléfono. Esta charla sobre la creación de un agente de IA me recuerda mucho al “nuevo Asistente de Google” anunciado con el Pixel 4 en 2019.

En I/O 2019, Google presentó este asistente de próxima generación. La hipótesis era que el procesamiento de audio en el dispositivo haría que «tocar para encender el teléfono pareciera casi lento».

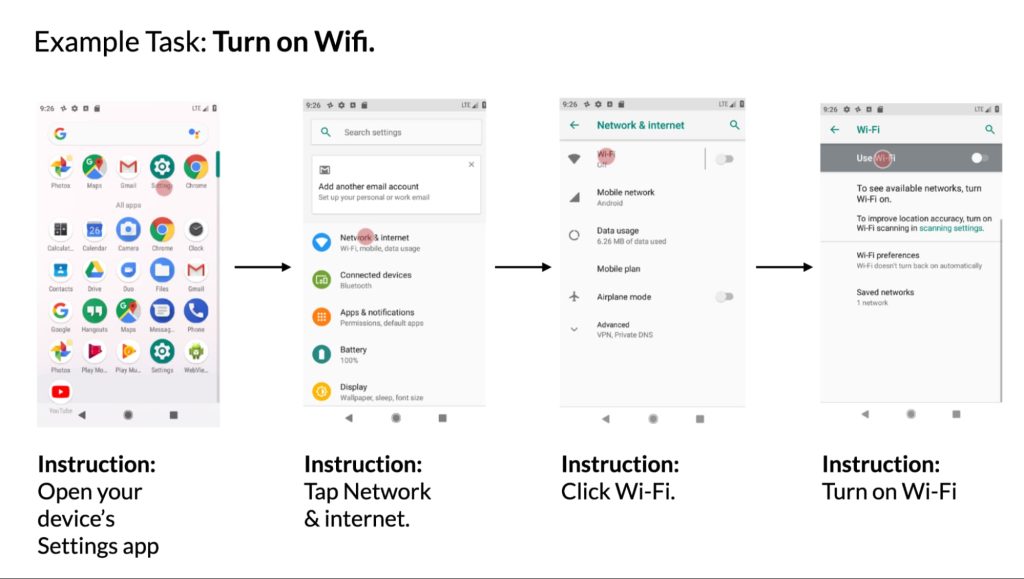

Google mostró comandos simples que incluían abrir y controlar aplicaciones, mientras que la idea más compleja era «cómo el asistente integrado del dispositivo puede coordinar tareas entre aplicaciones». El ejemplo fue recibir un mensaje de texto entrante, responder por voz y luego tener la idea de buscar una imagen adjunta y enviarla. La capacidad de «ejecutar» y «multitarea» se completa con la capacidad de «composición» en lenguaje natural de Gmail.

Este asistente de próxima generación le permitirá operar instantáneamente su teléfono con su voz, realizar múltiples tareas en aplicaciones y completar acciones complejas, todo con una latencia prácticamente nula.

El nuevo Asistente se lanzó en el Pixel 4 ese mismo año y estuvo disponible en todos los dispositivos de Google posteriores.

- «Toma una selfie.» Luego diga «Comparte esto con Ryan».

- En un hilo de conversación, diga «Responder, estoy en camino».

- «Encuentra clases de yoga en YouTube». Luego diga: «Comparte esto con mamá».

- «Muéstrame los correos electrónicos de Michelle en Gmail».

- Mientras la aplicación Google Photos esté abierta, diga «Muéstrame fotos de Nueva York». Luego diga «los de Central Park».

- Cuando el sitio de recetas esté abierto en Chrome, puedes decir «Buscar muffins de chocolate y nueces».

- Mientras la aplicación de viajes esté abierta, diga «Hoteles en París».

Ésta es la idea básica detrás de los agentes de IA. Durante la conferencia telefónica sobre resultados de Alphabet el mes pasado, se le preguntó a Sundar Pichai sobre el impacto de la IA generativa en Assistant. Dijo que permitiría al Asistente de Google «actuar como un proxy con el tiempo» e «ir más allá de las respuestas y seguir a los usuarios».

de acuerdo a la información Esta semana, OpenAI está trabajando en un proxy ChatGPT:

«Este tipo de solicitudes incitarían al agente a realizar clics, movimientos del cursor, escribir texto y otras acciones que los humanos realizan mientras trabajan con diferentes aplicaciones, según una persona familiarizada con el esfuerzo».

Luego está el Rabbit del modelo de acción grande (LAM), que está entrenado para interactuar con interfaces móviles y de escritorio existentes para completar una tarea específica.

La versión introducida por el Asistente de Google en 2019 parecía muy preprogramada y requería que los usuarios se comprometieran con ciertas frases en lugar de dejar que las personas hablaran con naturalidad y luego resaltaran automáticamente la acción. En ese momento, Google dijo que el Asistente «funciona perfectamente con muchas aplicaciones» y que «continuará mejorando las integraciones de aplicaciones con el tiempo». Hasta donde sabemos, esto nunca ha sucedido, mientras que algunas de las capacidades demostradas por Google ya no funcionan debido al cambio de aplicación. Un verdadero agente podrá adaptarse en lugar de depender de condiciones establecidas.

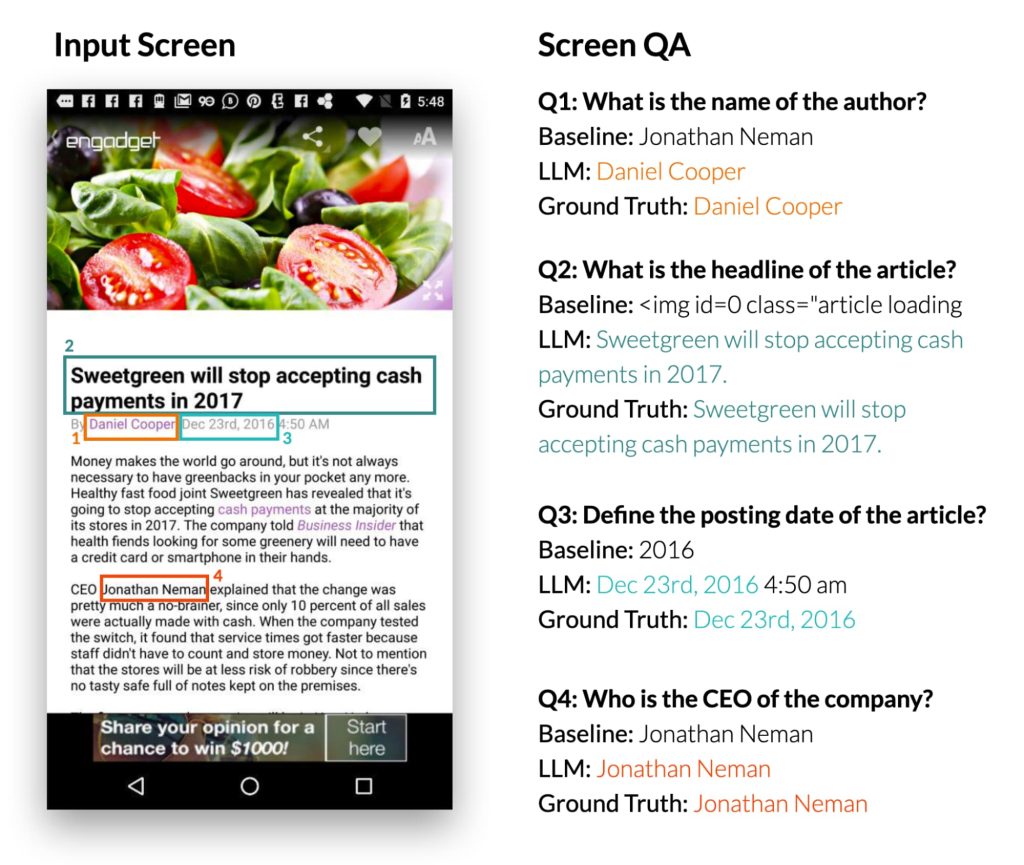

Es fácil ver cómo LLM podría mejorar esto, ya que el año pasado Google Research mostró el trabajo en «Habilitar la interacción conversacional con la interfaz de usuario móvil utilizando modelos de lenguaje grandes«.

La investigación de Google demostró que su enfoque es capaz de «comprender rápidamente la intención de una interfaz de usuario móvil»:

Curiosamente, observamos que los estudiantes de LLM utilizaron sus conocimientos previos para inferir información que no se presenta en la interfaz de usuario al crear resúmenes. En el siguiente ejemplo, el LLM dedujo que las estaciones de metro pertenecen al sistema de metro de Londres, mientras que la interfaz de usuario de entrada no contiene esta información.

También puede responder preguntas sobre el contenido que aparece en la interfaz de usuario y controlarlo después de recibir instrucciones en lenguaje natural.

El agente Gemini AI para su dispositivo Android será la evolución natural del primer intento nunca antes descubierto de Google de crear un asistente todo en uno que ofrezca una nueva forma de usar su teléfono. Sin embargo, existen funciones como copiar la respuesta al mensaje y luego poder decir «enviar» directamente en la escritura por voz del Asistente de Gboard.

Los esfuerzos anteriores parecen ser el resultado de que Google llegó tarde a presentar una idea y no tenía la tecnología necesaria. Ahora que hemos llegado hasta aquí, Google haría bien en priorizar este esfuerzo para poder empezar a liderar el campo en lugar de ponerse al día.

FTC: utilizamos enlaces de afiliados automáticos para obtener ingresos. más.

«Aficionado a Twitter aficionado. Experto en música. Evangelista total de la cerveza. Defensor de las redes sociales. Fanático de los zombis».

More Stories

El DLC Story de Mortal Kombat 1 Khaos Reigns llegará en septiembre y revela nuevos luchadores y animales invitados

No hay solución al problema del fallo de los procesadores Intel de 13.ª y 14.ª generación, es decir, daños permanentes

Galaxy Z Flip 6, Z Fold 6 y los nuevos wearables de Samsung salen a la venta