Ars Technica

El jueves, un par de entusiastas de la tecnología despidieron Untado, un modelo de inteligencia artificial que genera música a partir de indicaciones de texto creando una representación visual del sonido y convirtiéndolo en audio para su reproducción. Utiliza una versión exacta de propagación estable 1.5 Modelo de fotomontaje, aplicación óptica difusión latente Procesar el sonido de una manera nueva.

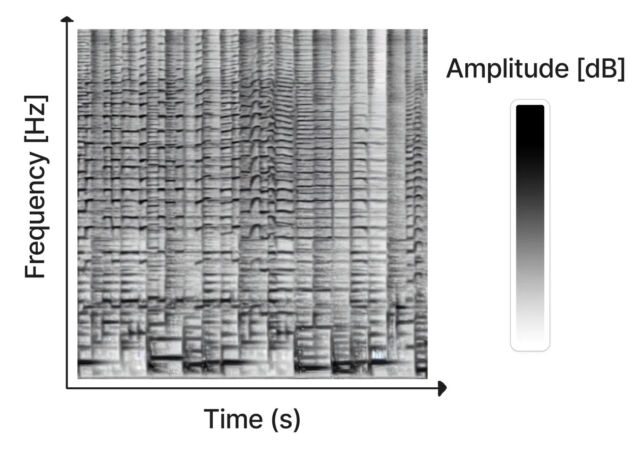

Creado como un proyecto de pasatiempo por Seth Forsgren y Hayk Martiros, Riffusion funciona creando audiogramas que almacenan sonido en una imagen 2D. En un gráfico de ultrasonido, el eje X representa el tiempo (el orden en que se reproducen las frecuencias, de izquierda a derecha) y el eje Y representa la frecuencia de los sonidos. Mientras tanto, el color de cada píxel de la imagen representa la amplitud del sonido en ese momento particular.

Debido a que un gráfico de ultrasonido es un tipo de imagen, Stable Diffusion puede procesarlo. Forsgren y Martiros entrenaron un modelo de difusión estable personalizado con ejemplos fonéticos vinculados a descripciones de los sonidos o géneros musicales que representan. Con este conocimiento, Riffusion puede crear instantáneamente nueva música basada en indicaciones de texto que describen el tipo de música o sonido que desea escuchar, como «jazz», «rock» o incluso escribir en el teclado.

Después de crear la imagen de ultrasonido, se usa Riffusion antorchaaudio Para cambiar el sonido de las ondas sonoras en sonido y reproducirlo como sonido.

“Esta es una plantilla de Stable Diffusion v1.5 sin modificaciones, solo imágenes de espectrograma ajustadas con texto”, escribieron los creadores de Riffusion en una publicación de blog. página de explicación. «Se pueden generar innumerables variaciones del vector diversificando las semillas. Las interfaces de usuario web y las técnicas como img2img, inpainting, indicaciones negativas e interpolación funcionan de manera inmediata».

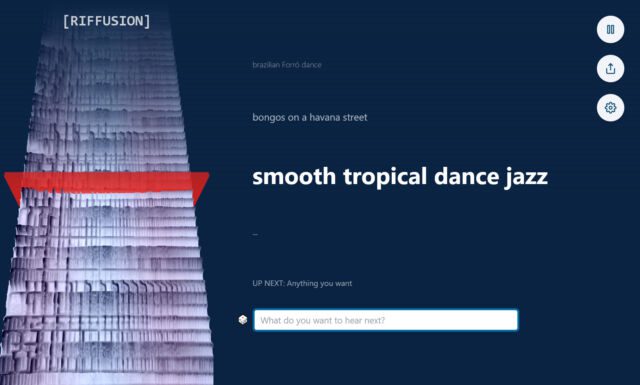

Visitantes de la Riffusión Un experimento modelo de inteligencia artificial Con una aplicación web interactiva que genera audiogramas interpolados (unidos a la perfección para una reproducción ininterrumpida) en tiempo real con el espectrograma visualizado continuamente en el lado izquierdo de la página.

También puede incorporar estampados. Por ejemplo, escribir en «Tropical Soft Jazz» incorpora elementos de diferentes géneros para una partitura fresca, fomentando la experimentación mediante la mezcla de estilos.

Por supuesto, Riffusion no es el primer generador de música impulsado por IA. a principios de este año, Armonía liberado Propagación de baile, un modelo de música generativa impulsado por IA. IA abierta tocadiscos tragamonedas, que se anunció en 2020, también genera nueva música con una red neuronal. y sitios como dibujo de sol Crea música sin parar sobre la marcha.

En comparación con esos esfuerzos musicales simplificados de IA, Riffusion parece más el proyecto de pasatiempo que es. La música que genera varía de interesante a incomprensible, pero sigue siendo una aplicación notable de la técnica de difusión latente que procesa el sonido en el espacio visual.

El modelo Riffusion es a la vez un token y un punto de control. Disponible en github.

«Aficionado a Twitter aficionado. Experto en música. Evangelista total de la cerveza. Defensor de las redes sociales. Fanático de los zombis».

More Stories

El community manager de Helldivers 2 parece haber sido despedido después de fomentar críticas negativas sobre el mandato de PSN ahora rescindido: «Sabía que estaba arriesgando lo que dije»

Apple anuncia un Magic Keyboard rediseñado para el nuevo iPad Pro, desde $299

Anunciando el ‘sucesor’ de Nintendo Switch que llegará ‘este año fiscal’